智东西(公众号:zhidxcom)

编译 | 吴菲凝

编辑 | 李水青

智东西3月7日报道,根据谷歌官网,谷歌的通用语音模型USM目前已实现升级,支持100多个语种内容的自动识别检测。

去年11月,谷歌曾计划创建一个支持1000个语种的AI模型USM。谷歌将其描述为“最先进的通用语音模型”,拥有20亿个参数,经过涵盖1200万小时的语音、280亿个句子和300多个语种数据集的预训练。

USM的强大效果目前已在Youtube的字幕生成中展现出来,可自动翻译和检测如英语、汉语等主流语种,还能识别出阿萨姆语这种小众语种,可以说“精通方言”。

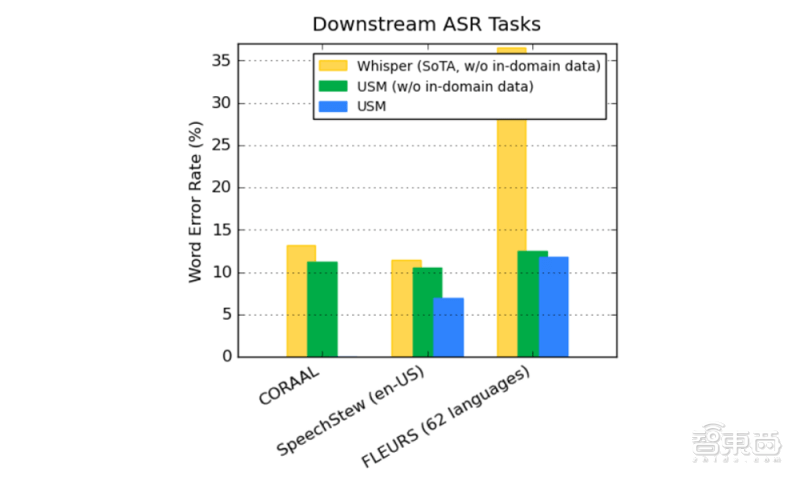

根据谷歌博客,与OpenAI的大型通用语音模型Whisper相比,USM的数据训练时长更短,错误率更低。

一、可自动检测翻译100+语种,USM面临两大挑战

当微软和谷歌还在为谁家的AI聊天机器人更智能而争论不休时,我们需要清楚,语音模型的用途远不止于此。

外媒The Verge的记者称,除了相传将在今年的I/O开发者大会中展示的20多款AI驱动产品之外,谷歌目前还在朝着更高目标迈进——构建一个支持1000种语种的机器学习模型。

在周一发布的更新中,谷歌分享了更多有关USM的信息,谷歌称,这是构建支持1000种语言的通用语音模型的“关键第一步”。

USM已被YouTube用于生成字幕,它还支持自动语音识别(ASR),可自动检测和翻译语言,不仅包括普通话、英语等广泛使用的语言,还包括阿姆哈拉语、宿务语、阿萨姆语等冷门语言。

目前,谷歌称USM可支持检测100多个语种,并将作为构建更大的系统的“基础”。不过,这项技术似乎还有些遥远,谷歌在I/O开发者大会期间对阿拉伯语的错误表述就已证明。

谷歌研究院科学家张宇(Yu Zhang)和软件工程师詹姆斯·秦(James Qin)在谷歌博客上发文称,为了实现USM这个雄心勃勃的目标,他们目前需要解决ASR面临的两个重大挑战。

一是传统的学习方法的缺乏可扩展性。语音技术扩展到多语种的一个基本挑战是需要足够的数据来训练高质量的模型,使用传统方法时,需要手动将音频数据进行标记,既耗时又价格高昂,对于那些小众冷门的语种而言,也更难找到预先存在的来源收集。因此,研究院后续准备将传统学习方法转变为自我监督学习,利用纯音频来收集数据。

二是在扩大语言覆盖范围和质量的同时,模型必须以计算效率更高的方法来改进。这就要求学习算法更加灵活、高效、泛化。这些算法需要使用来源广泛的数据,并在不用完全训练的情况下更新模型,再推广到新的语言中。